As comissões temáticas do Senado devem analisar em breve o PL 2.338/2023 para regulamentar o setor de Inteligência Artificial (IA) no Brasil.

O texto estabelece direitos para usuários, multas de até R$ 50 milhões por infração ou até 2% do faturamento, no caso de empresas. Transparência e direitos autorais também são tópicos prioritários.

O PL também define critérios para o uso das IAs pelo poder público e atribuí ao Poder Executivo a prerrogativa de decidir que órgão irá fiscalizar e regulamentar o setor.

Leia mais: Sofri um golpe, e agora? Como agir em casos de fraude

IA analisa o próprio destino

Com tantos pontos para serem analisados o engenheiro elétrico, CEO e fundador da da Hubchain Tecnologia, Rodrigo Pimenta teve a ideia de entrevistar a própria IA. Ele e uma equipe criaram uma Inteligência Artificial para analisar o projeto.

Pimenta explica que a PL-2338 “aborda principalmente a regulamentação da inteligência artificial e seus impactos negativos, como a discriminação, a falta de transparência e a responsabilização civil, direitos civil e digital fundamentais de pessoas afetadas.

E também mostra que o uso da Inteligência Artificial (IA) deve ter um “responsável” e o seu comportamento como ética, moderação e aplicação deve ser mantido a fim de que se tenha algum controle sobre abusos ou ações inapropriadas, esclarece o executivo da Hubchain Tecnologia..

O pesquisador premiado do CNPq, autor de publicação de Inteligência Artificial e Algoritmos Genéticos contou ao BeInCrypto como foi o processo.

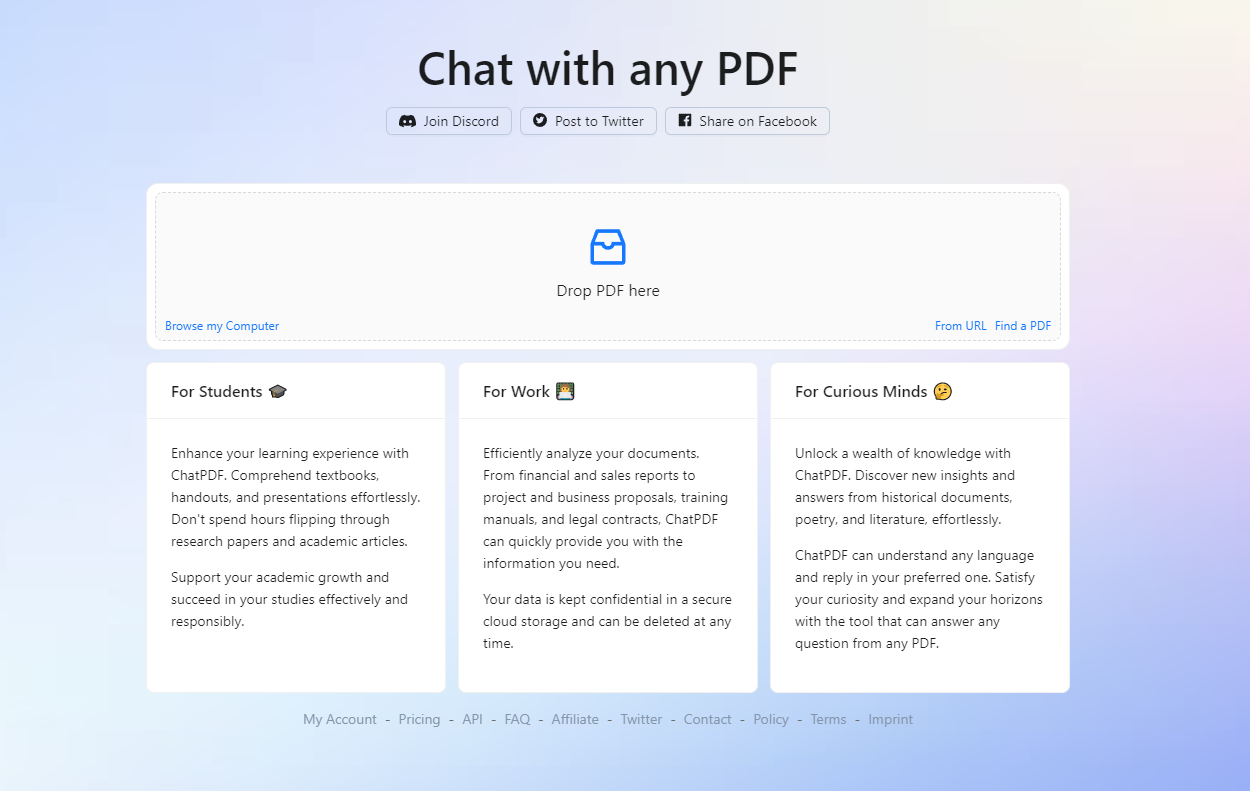

Primeiro ele fez o download, em PDF, do conteúdo da “PL-2338 – Uso da Inteligência Artificial” e em seguida fez o upload do PDF na ferramenta online “ChatPDF” de “Inteligência Artificial”, similar ao ChatGTP v4.

Após essa etapa Rodrigo e uma equipe perguntaram a IA: Quais são os pontos positivos e pontos negativos sobre essa iniciativa?

“Em nossa opinião, foram bem sensatas as respostas recebidas e compartilhamos exatamente os mesmos pontos de vista. No entanto, estranhamente, a própria IA apresentou 16 pontos negativos (e preocupantes), contra 14 pontos positivos sobre esta iniciativa. Todos são convidados a tirar suas próprias conclusões.”

Resposta do ChatPDF (Inteligência Artificial) sobre o Projeto de Lei para o setor.

Os 14 pontos positivos do PL-2338 citados pela IA foram:

1. Estabelece normas gerais para o desenvolvimento, implementação e uso responsável de sistemas de inteligência artificial no Brasil.

2. Protege os direitos fundamentais das pessoas afetadas por sistemas de IA.

3. Garante acesso apropriado à informação e adequada compreensão das decisões tomadas por esses sistemas.

4. Estabelece o direito de contestar decisões automatizadas e solicitar intervenção humana.

5. Disciplina o direito à não-discriminação e à correção de vieses discriminatórios.

6. Promove o desenvolvimento tecnológico e a inovação no país.

7. Busca garantir a segurança e confiabilidade dos sistemas de IA utilizados no Brasil.

8. Estimula a criação de um ambiente regulatório experimental (sandbox regulatório) para fomentar a inovação da inteligência artificial.

9. Busca proteger o meio ambiente e promover o desenvolvimento sustentável.

10. Promove a livre iniciativa, livre concorrência e defesa do consumidor.

11. A iniciativa busca estabelecer um equilíbrio entre a inovação tecnológica e a proteção dos direitos humanos.

12. A proposta prevê a criação de um comitê de ética para orientar o desenvolvimento e uso responsável de sistemas de IA.

13. A iniciativa pode ajudar a evitar o uso indevido ou abusivo de sistemas de IA em áreas como segurança pública, saúde e educação.

14. A proposta pode incentivar empresas e organizações a adotarem práticas mais transparentes e responsáveis no desenvolvimento e uso de sistemas.

Por outro lado os 16 pontos negativos do PL-2338 apresentados pela IA foram:

1. Pode haver dificuldades na implementação das normas estabelecidas pelo projeto de lei.

2. Pode haver resistência por parte das empresas que desenvolvem sistemas de IA em relação às novas regulações propostas pelo projeto.

3. Pode haver custos adicionais para as empresas que precisam se adequar às novas normas estabelecidas pelo projeto.

4. Pode haver dificuldades em definir critérios claros para avaliação e desencadeamento de ações para mitigação dos riscos envolvidos no uso de sistemas de IA.

5. Pode haver dificuldades em garantir o acesso apropriado à informação e adequada compreensão das decisões tomadas por sistemas de IA.

6. Pode haver dificuldades em garantir o direito de contestar decisões automatizadas e solicitar intervenção humana.

7. Pode haver limitações na capacidade do governo em fiscalizar e monitorar o uso de sistemas de IA, o que pode levar a violações das normas estabelecidas pelo projeto.

8. Pode haver impacto negativo na inovação e desenvolvimento tecnológico, caso as novas regulações sejam muito restritivas ou onerosas para as empresas.

9. Pode haver dificuldades em garantir a transparência e explicabilidade dos sistemas de IA, o que pode afetar a confiança do público no uso dessas tecnologias.

10. Pode haver desafios em relação à proteção da privacidade e segurança dos dados pessoais coletados pelos sistemas de IA.

11. Pode haver dificuldades em garantir a equidade no acesso aos benefícios proporcionados pelos sistemas de IA, especialmente para grupos vulneráveis ou marginalizados.

12. Pode haver impacto negativo na competitividade das empresas brasileiras em relação a empresas estrangeiras que não estejam sujeitas às mesmas regulações.

13. Pode haver dificuldades em definir responsabilidades claras em caso de danos causados pelo uso inadequado ou malicioso de sistemas de IA.

14. Pode haver dificuldades em garantir a atualização constante das normas estabelecidas pelo projeto, devido à rápida evolução da tecnologia de IA.

15. Pode haver impacto negativo na liberdade de expressão e no direito à informação, caso as novas regulações restrinjam o uso de sistemas de IA para fins jornalísticos ou de pesquisa.

16. Pode haver dificuldades em garantir a interoperabilidade entre diferentes sistemas de IA, o que pode afetar a eficácia e moderação e controle de ética.

E você concorda com a IA?

- Não entendeu algum termo do universo Web3? Confira no nosso Glossário!

- Quer se manter atualizado em tudo o que é relevante no mundo cripto? O BeInCrypto tem uma comunidade no Telegram em que você pode ler em primeira mão as notícias relevantes e conversar com outros entusiastas em criptomoedas. Confira!

- Você também pode se juntar a nossas comunidades no Twitter (X), Instagram e Facebook.