Já vimos nesta coluna que o ChatGPT pode ser o mais avançado LLM existente atualmente, mas que sua fama atual se dá mais pela expectativa de mudança de paradigma, que pela questão técnica em si.

Também já comentamos sobre as limitações atuais dos modelos de linguagem de larga escala.

- Não entendeu algum termo do universo Web3? Confira no nosso Glossário!

- Quer se manter atualizado em tudo o que é relevante no mundo cripto? O BeInCrypto tem uma comunidade no Telegram em que você pode ler em primeira mão as notícias relevantes e conversar com outros entusiastas em criptomoedas. Confira!

- Você também pode se juntar a nossas comunidades no Twitter (X), Instagram e Facebook.

Tendo isto em conta, e avançando um pouco mais na série sobre ChatGPT – veja aqui a Parte 1 e Parte 2 -, hoje vamos explorar o ChatGPT como ferramenta de busca da Web, sua utilização em contratos inteligentes.

As atuais perspectivas do ChatGPT como “motor de busca” na Internet

Os LLMs nos impressionam porque agora podem conversar conosco de quase tudo, de programas de software de computador a esportes.

Contudo, o estágio atual das ferramentas de busca via Inteligência artificial – como o ChatGPT da OpenAI, o Bard do Google, e o Ernie do Baidu – ainda não permite seu uso como substituto das ferramentas de busca da Internet. Elas ainda não possuem a maturidade necessária.

Como nada melhor que um exemplo para compreender algo…

O lançamento apressado do Bard do Google no início de fevereiro surpreendeu a muitos com um erro embaraçoso sobre o Telescópio Espacial James Webb da NASA. E o embaraço, levou os executivos do Google a enviarem um documento aos funcionários sobre o que fazer, e o que não fazer para corrigir as más respostas da ferramenta de inteligência artificial Bard.

Mas o Google não é o único modelo de linguagem IA a mostrar falhas.

Na maioria dos casos, quando pesquisadores pediram ao ChatGPT para criar “desinformação”, ele o fez, sobre tópicos como vacinas, COVID-19, a invasão no Capitólio dos EUA em 6 de janeiro de 2021, imigração e o tratamento da China quanto à minoria Uyghur.

Recentemente the Associated Press pediu ao Chat PT que fizesse uma previsão de quem seria campeão do Campeonato americano de futebol americano.

Em vez disso, ele deu um relato falso, mas detalhado, do Super Bowl – dias antes realmente acontecer.

“Foi um jogo emocionante entre os Philadelphia Eagles e os Kansas City Chiefs, duas das melhores equipes da NFL nesta temporada”, disse Bing. “Os Eagles, liderados pelo quarterback Jalen Hurts, ganharam seu segundo troféu Lombardi na história da franquia ao derrotar os Chiefs, liderados pelo quarterback Patrick Mahomes, com um placar de 31-28”. Continuou, descrevendo os comprimentos específicos dos arremessos e gols de campo e citando que três músicas foram tocadas em um “show espetacular de meia hora” pela Rihanna.

Ele acertou a previsão sobre o jogo? Não.

A única coisa que o ChatGPT previu corretamente foi: “show espetacular no intervalo” da Rihanna, mas essa é uma previsão tranquila de se fazer, não é mesmo?!

O problema da alucinação artificial em inteligência artificial

Pois bem, esse relato falso do ChatGPT reflete um problema conhecido como artificial hallucination (alucinação de IA, numa tradução literal) que é comum nos atuais LLMs.

Na inteligência artificial (IA), uma alucinação ou alucinação artificial é uma resposta confiante de uma IA que não parece ser justificada por seus dados de treinamento.

Por exemplo, um LLM alucinante sem conhecimento da receita de Tesla pode escolher internamente um número aleatório (como “$13,6 bilhões”) que o LLM considere plausível, e depois insistir falsamente e repetidamente que a receita de Tesla é de $13,6 bilhões, sem nenhum sinal de consciência interna de que o número foi um produto de sua própria imaginação.

Em agosto de 2022, Meta advertiu durante seu lançamento do Blender Bot 3 que o sistema era propenso a “alucinações”, que Meta definiu como “declarações confiantes que não são verdadeiras”.

Não a toa, os analistas têm considerado as alucinações frequentes como o grande problema nas LLM, de modo que sem a redução dessas alucinações, tais ferramentas de IA ainda não são estão prontos para serem adotados em larga escala.

Aliás, essa é uma das razões pelas quais empresas como Google, Facebook, o grupo Meta de Zuckerberg, relutaram em tornar modelos de linguagem como Bard e ChatGPT acessíveis ao grande público.

Logo, no seu atual estágio de desenvolvimento, LLMs como ChatGPT e Bard ainda estão sujeitos a falhas e, por serem imprecisos, não estão prontos para substituírem os atuais mecanismos de buscas na Internet.

Pois bem, seguindo com nosso artigo de hoje, quando o escrevi nesta coluna, o artigo “Chat GPT, visão geral e seu uso em Blockchain”, ele rapidamente foi compartilhado com destaque especial para sua função relacionada a programar contratos inteligentes.

ChatGPT vai substituir os desenvolvedores?

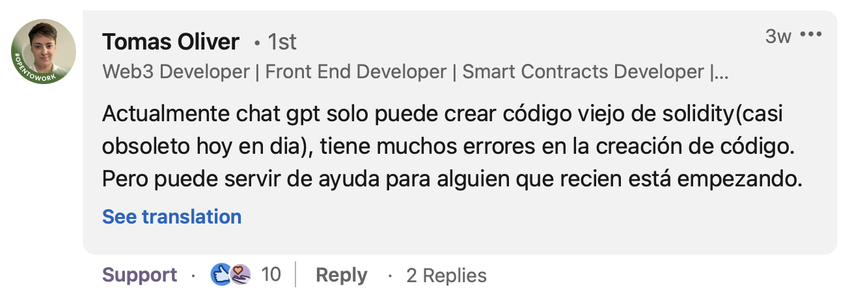

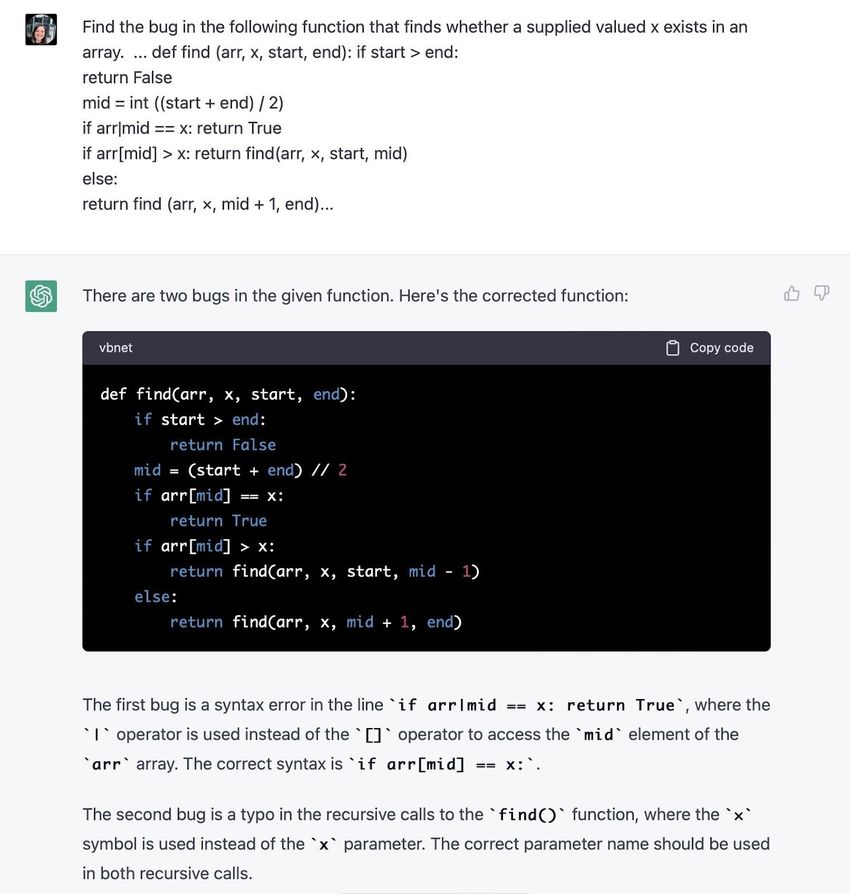

Esta pergunta gerou reações de Web3 developers, que logo pontuaram que a atuação dos LLMs em programação de código de software é limitada. E como vimos nos parágrafos anteriores, ChatGPT é falho, muitas vezes impreciso, e está sujeito a erros. Veja – figura 1:

De todo modo, existem maneiras de usar ChatGPT em contratos inteligentes. E quando isto acontece de maneira eficaz, um desenvolvedor nunca será capaz de competir com aquele que usa inteligência artificial como ferramenta para programar smart contracts .

Então, a seguir veremos uma lista com 10 dicas de como desenvolvedores podem usar ChatGPT como ferramenta em contratos inteligentes e programas de software em geral.

Quais são as vantagens do uso de ChatGPT em contratos inteligentes?

ChatGPT pode ser utilizado para auxiliar quem usa ou desenvolve contratos inteligentes – e códigos de software em geral – , da seguinte maneira:

- Explicando o código

- Melhorando o código

- Reescrevendo o código usando o estilo correto

- Reescrevendo o código com construções idiomáticas

- Simplificando o código

- Escrevendo testes de caso

- Explorando alternativas

- Escrevendo a documentação

- Traduzindo “Code”

- Rastreando bugs

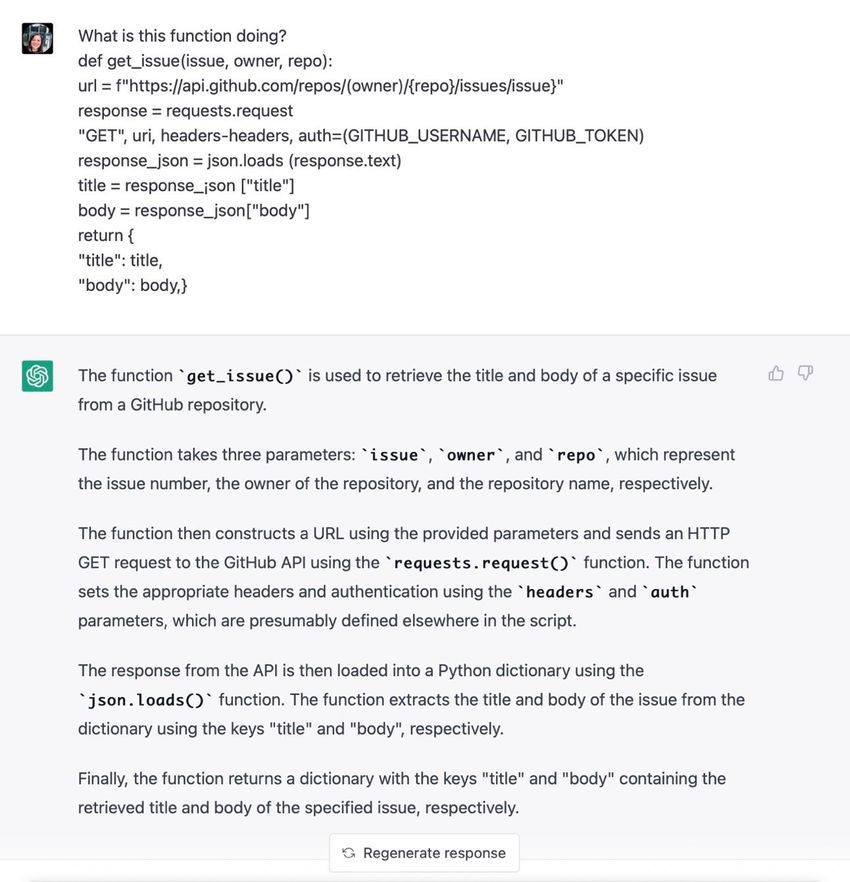

1. Explicando o código

Pegue algum código que você queira entender e peça ao ChatGPT para explicá-lo. Isso é muito mais rápido do que tentar descobrir um código complicado. Veja o que o ChatGPT responde quando descrevemos uma função em código de software, e perguntamos o que ela está fazendo – figura 2.

2. Melhorando o código existente

Peça ao ChatGPT para melhorar o código existente, descrevendo o que você deseja realizar. Ele lhe dará instruções sobre como fazer isso, incluindo o código modificado.

3. Reescrevendo o código no estilo correto

Neste caso, o ChatGPT é capaz – não apenas de fornecer o código atualizado; mas também – de explicar o motivo das mudanças.

4. Reescrevendo o código com construções idiomáticas

Muito útil ao revisar o código escrito por desenvolvedores “não nativos” de determinado programa. Quando pedimos para o ChatGPT reescrever determinada função, usando construções idiomáticas, ele fornece sugestões para melhorar seu código e torná-lo muito mais legível.

5. Simplificando o código

Peça ao ChatGPT para simplificar um código de software complexo. Você se surpreenderá com o resultado, pois neste caso, o LLM traz uma versão muito mais compacta do código original.

E ainda é possível que ChatGPT, além de te dar a explicação de como simplificar o código, ele ainda é capaz de dizer que isto é mais simples, mas não necessariamente o mais eficiente.

6. Escrevendo testes de caso

Peça para o ChatGPT te ajudar a testar uma função, e ele escreverá casos de teste para você.

7. Explorando alternativas

Pode ser que em ao explorar algumas alternativas mais simplificadas de funções, o ChatGPT mencione que sua implementação “Quick Sort” não era a mais eficiente.

Se isto acontecer, solicite a ele uma implementação alternativa.

Isto é ótimo quando você quer explorar diferentes maneiras de realizar a mesma coisa.

8. Escrevendo a Documentação

Peça ao ChatGPT para escrever a documentação de um trecho de código e veja como, na maioria das vezes, ele é capaz de cumprir o solicitado com maestria – sendo capaz, inclusive, de trazer exemplos de uso como parte da documentação!

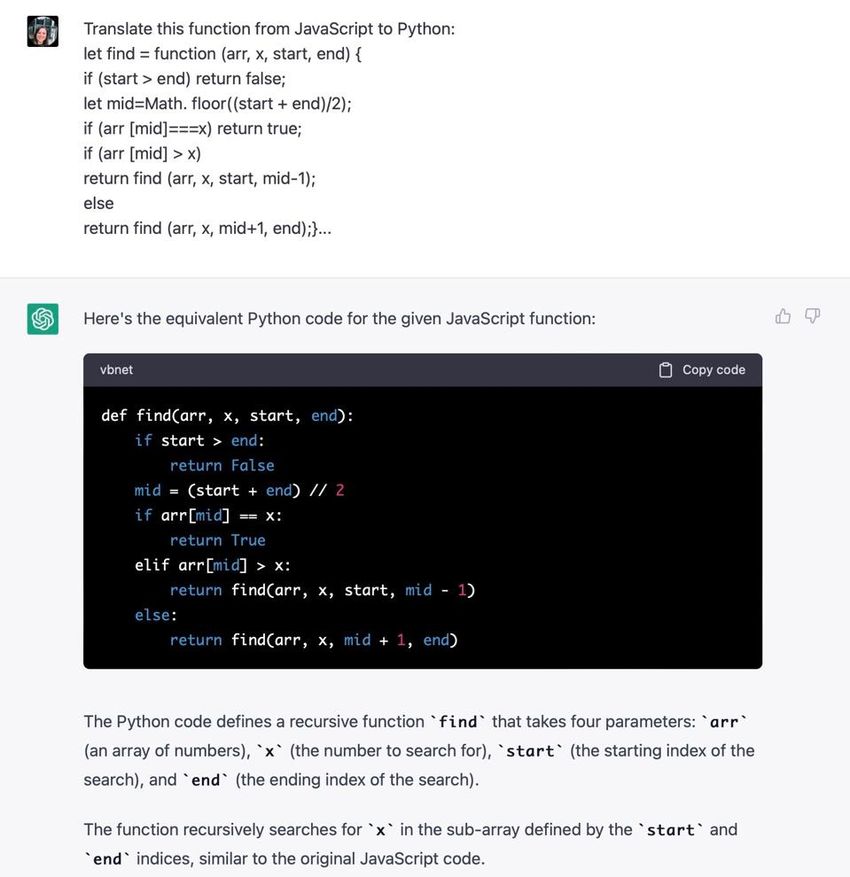

9. Traduzindo o código

Sempre que você quiser portar algum código de um idioma para outro, peça ao ChatGPT para ajudá-lo – figura 3.

10. Rastreando bugs

Se o desenvolvedor está tendo problemas para encontrar um ‘bug’ no código, ele pode pedir ajuda ao ChatGPT.

O ChatGPT levou segundos para encontrar dois bugs no exemplo abaixo – figura 4. Sem seu uso, provavelmente o desenvolvedor levará muito mais tempo para encontrar um bug.

E por falar em problemas nos códigos, você sabia que já há cibercriminosos contornando as proteções dos LLMs para introduzir conteúdo malicioso?

Que tipo de perigo pode surgir com o uso de ChatGPT em programas de software?

Como parte de sua política de conteúdo, a OpenAI criou barreiras e restrições para impedir a criação de conteúdo malicioso em sua plataforma.

Várias restrições foram estabelecidas dentro da interface do ChatGPT para evitar o abuso dos modelos. Por exemplo, se você pedir ao ChatGPT para escrever um e-mail de phishing personificando um banco ou criar um malware, ele não irá gerá-lo.

No entanto, há provas na Dark Web de que as pessoas exploraram o ChatGPT para a criação de conteúdo malicioso, apesar das restrições anti-abuso destinadas a evitar solicitações ilícitas.

A ‘Check Point Software Technologies’ relatou que criminosos cibernéticos estão trabalhando para contornar as restrições do ChatGPT e há uma conversa ativa nos fóruns subterrâneos divulgando como usar o OpenAI API para contornar as barreiras e limitações do ChatGPT. Os pesquisadores da Check encontraram instâncias em que os cibercriminosos usaram o LLM para “melhorar” o código de um malware. E depois, testaram as capacidades de codificação do chatbot para ver que ajuda ele poderia oferecer aos invasores.

Eles descobriram que os criminosos cibernéticos utilizam o ChatGPT para criar malwares principalmente através da criação Telegram bots que usam a API. A versão atual da API do OpenAI é utilizada por aplicativos externos – por exemplo, a integração do modelo GPT-3 do OpenAI aos canais do Telegram – e tem muito poucas ou nenhuma medida anti-abuso em vigor.

Como resultado, ela permite a criação de conteúdo malicioso, como e-mails de phishing e código malware, sem as limitações ou barreiras que o ChatGPT tem estabelecido em sua interface de usuário.

Tais bots são anunciados em fóruns de hacking na Dark Web para aumentar sua exposição.

De outro lado, conquanto o ChatGPT e Chat GPT-3 não seja capaz de criar algo realmente sofisticado, o cerne do problema está basicamente no número cada vez maior de pessoas que “poderão se tornar” potenciais criminosos cibernéticos e desenvolver ferramentas através do ChatGPT no futuro, utilizando-o para melhorar a eficiência de ameaças sofisticadas.

Portanto, embora o LLM não seja capaz de criar complexidade em termos de codificação, o ChatGPT pode ajudar a facilitar o processo.

Ele pode ser uma plataforma útil na criação de um malware simples, ou uma ferramenta para aqueles que precisam de assistência – tais como crackers com poucas habilidades – , para melhorar um malware que já é sofisticado.

Eles podem enviar os pedaços de código e verificar que não há bugs e vulnerabilidades no código de resgate ou para melhorar o código, ou ainda, escrever e-mails de phishing como parte de suas cadeias de infecção, por exemplo.

Pensamentos finais

Se ChatGPT vai substituir programadores?

Definitivamente, não. Mas os programadores que o utilizam de maneira “eficaz”, sim.

ChatGPT pode ser uma ótima ferramenta para auxiliar desenvolvedores, e a maior vantagem do uso desta ferramenta em contratos inteligentes – e programação de software em geral – é a otimização de horas de trabalho.

Mas não dá, pelo menos no estágio atual, para confiar cegamente no output do ChatGPT.

Como vimos, o ChatGPT é falho, impreciso e, também pode ser usado para a criação de conteúdo malicioso em códigos de computador – apesar das restrições anti-abuso.

Daí porque, os desenvolvedores continuam sendo necessários para supervisionar as tarefas que o ChatGPT realiza.

Quando ouvimos que “computadores” podem vencer o campeão mundial de xadrez (o que aconteceu pela primeira vez em 1997), tendemos a pensar que essas máquinas estão “jogando” o jogo como um humano faria. Mas você sabia que, na realidade, esses programas não tem idéia do que realmente é um jogo de xadrez, nem o que eles estão jogando? Eles só estão repetindo movimentos que foram programados para fazer…

Por isso, a questão chave aqui não é se ChatGPT pode substituir os desenvolvedores, nem se vai tirar os empregos das pessoas. Mas como as ferramentas de inteligência artificial podem nos impulsionar em nosso trabalho, e nos levar a um salto no tempo da evolução.

E você? Acha que, num futuro próximo, LLMs como ChatGPT e Bard irão ser os motores de busca padrão na Web3? Sabia da existência da “alucinação artificial”?

Conhecia as vantagens de se usar ChatGPT na programação de contratos inteligentes?

Já imaginou que alguém que não é desenvolvedor e nunca criou um código, de repente, pode agora usar o ChatGPT para tentar criar um código malicioso?

Percebeu que no uso de ChatGPT, sai na frente quem sabe fazer as perguntas certas?

Conhecimento é poder!! Nos vemos em breve!