A empresa controladora do ChatGPT, OpenAI, anunciou uma equipe de prevenção para avaliar os riscos apresentados pelos modelos de inteligência artificial (IA).

Embora os modelos de IA possam mudar a humanidade para melhor, eles apresentam vários riscos. Consequentemente, os governos estão preocupados com a gestão de riscos da tecnologia.

Leia mais: Sofri um golpe, e agora? Como agir em casos de fraude

Funções da equipe de prevenção da OpenAI

Por meio de uma postagem em seu site oficial, a OpenAI anunciou o lançamento da equipe de prevenção. A equipe trabalhará sob a liderança de Aleksander Madry, diretor do Centro de Aprendizado de Máquina Implantável do Instituto de Tecnologia de Massachusetts.

Os limites da IA apresentam certos riscos, como:

- Persuasão individualizada

- Cibersegurança

- Ameaças químicas, biológicas, radiológicas e nucleares (QBRN)

- Replicação e adaptação autônoma (ARA)

Além disso, existe o risco de desinformação e propagação de boatos através da inteligência artificial.

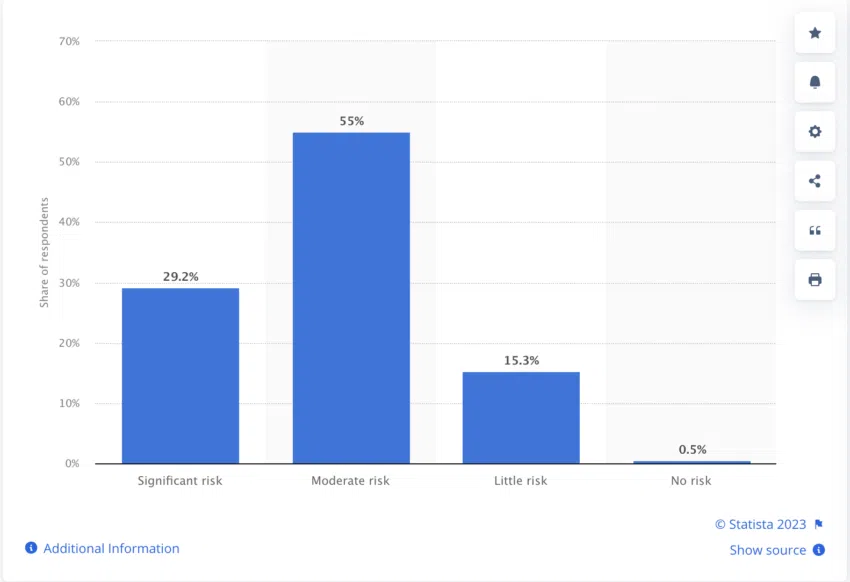

A captura de tela abaixo mostra a proporção de profissionais que acreditam que a inteligência artificial generativa (IA) representa um risco à segurança da marca e à desinformação em todo o mundo.

O governo do Reino Unido define os limites de IA como:

“Modelos de IA de uso geral altamente capazes que podem executar uma ampla variedade de tarefas e igualar ou exceder os recursos presentes nos modelos mais avançados de hoje.”

A equipe de preparação da OpenAI se concentrará no gerenciamento dos riscos causados pelos eventos catastróficos mencionados acima.

A controladora do ChatGPT chama esse desenvolvimento de sua contribuição para a próxima cúpula global de IA no Reino Unido.

Também em julho, os porta-bandeiras da IA, como OpenAI, Meta, Google e outros, comprometeram-se com a segurança e a transparência no desenvolvimento da IA na Casa Branca.

Ontem, o BeInCrypto informou que o primeiro-ministro do Reino Unido, Rishi Sunak, não quer se apressar na regulamentação da inteligência artificial. Entre outros fatores, ele está preocupado com a possibilidade da humanidade perder completamente o controle da IA.

- Não entendeu algum termo do universo Web3? Confira no nosso Glossário!

- Quer se manter atualizado em tudo o que é relevante no mundo cripto? O BeInCrypto tem uma comunidade no Telegram em que você pode ler em primeira mão as notícias relevantes e conversar com outros entusiastas em criptomoedas. Confira!

- Você também pode se juntar a nossas comunidades no Twitter (X), Instagram e Facebook.